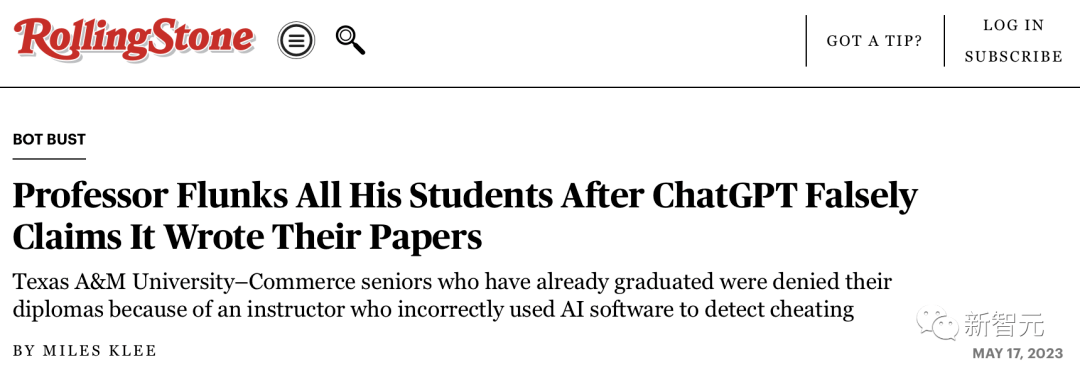

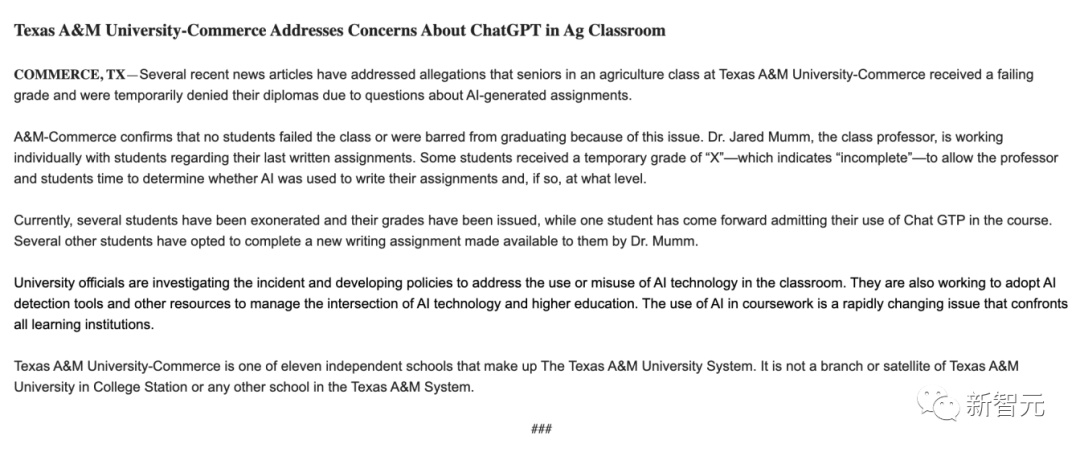

ChatGPT引发的学术争议:美国教授用其查重全给0分,半个班同学受影响

文章主题:文章关键词:美国教授,ChatGPT,查重,毕业论文,抄袭, half class, graduation, Twitter, Texas A&M。

半个班延毕!美国教授用ChatGPT「查重」全给0分,登微博热搜

来源:新智元

【新智元导读】天下苦GPT检测器久矣!用AI的怕被揪出来,没用AI的怕被冤枉。最近,又发生了一起被AI误判的冤假错案。离了个大谱!

最近,一位美国教授为了解决学生用AI作弊的问题,决定用「魔法」打败「魔法」。

但完全没搞懂原理的他,在「查重」时竟然用的是ChatGPT。

于是,同学们辛辛苦苦码出的毕业论文,通通被胡说八道的ChatGPT判定为「抄袭」。

而教授不仅据此挂掉了半个班的人,学校也拒发毕业证……

甚至,这件事直接火到了大洋彼岸,一度登上了微博的热搜。

教授:被ChatGPT认领的,都得0分

前段时间,在得克萨斯农工大学(Texas A&M),发生了这样一件令人哭笑不得的事。

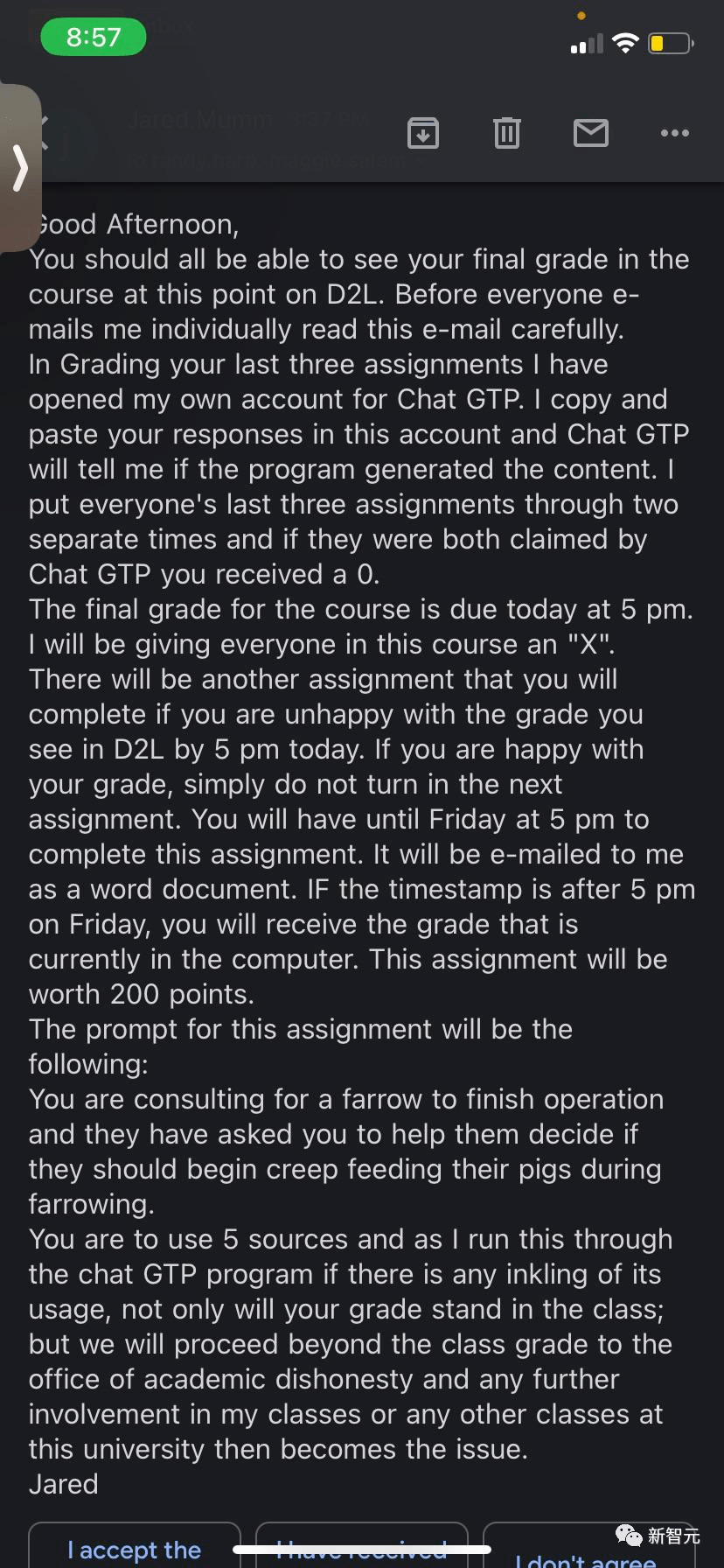

在以确保学生论文的原创性方面,Jared Mumm教授采取了一项创新措施,将学生的论文提交给ChatGPT进行检测。

他对学生们说:我会把你们的论文复制粘贴到ChatGPT中,它会告诉我,你们的论文是不是它生成的。

在两个 distinct的时间段内,我将个人的最后三篇论文分别纳入评估。若这两次提交都获得ChatGTP的认可,那么您的分数将不会得到任何评分。

显然,没有任何计算机相关背景知识的Mumm教授,对ChatGPT的原理一窍不通。

实际上,ChatGPT并不能识别由AI创建的内容,即使是它自己写的都不行。

甚至,他连ChatGPT都没拼对——直接写成了「Chat GPT」以及「chat GPT」。

结果,全班有一多半人的论文被ChatGPT不负责任地「认领」,因而挂了这一科。

更倒霉的是,大多数已毕业学生的文凭,因此直接被学校拒发了。

当然,Mumm教授也不是毫不留情,他为全班同学提供了重做作业的机会。

如何证明自己没用ChatGPT?

在收到上述电子邮件后,一些学生为了澄清自己的清白,纷纷致信给Mumm。他们提供的证据包括带有时间戳的Google文档,旨在证明并未利用ChatGPT。

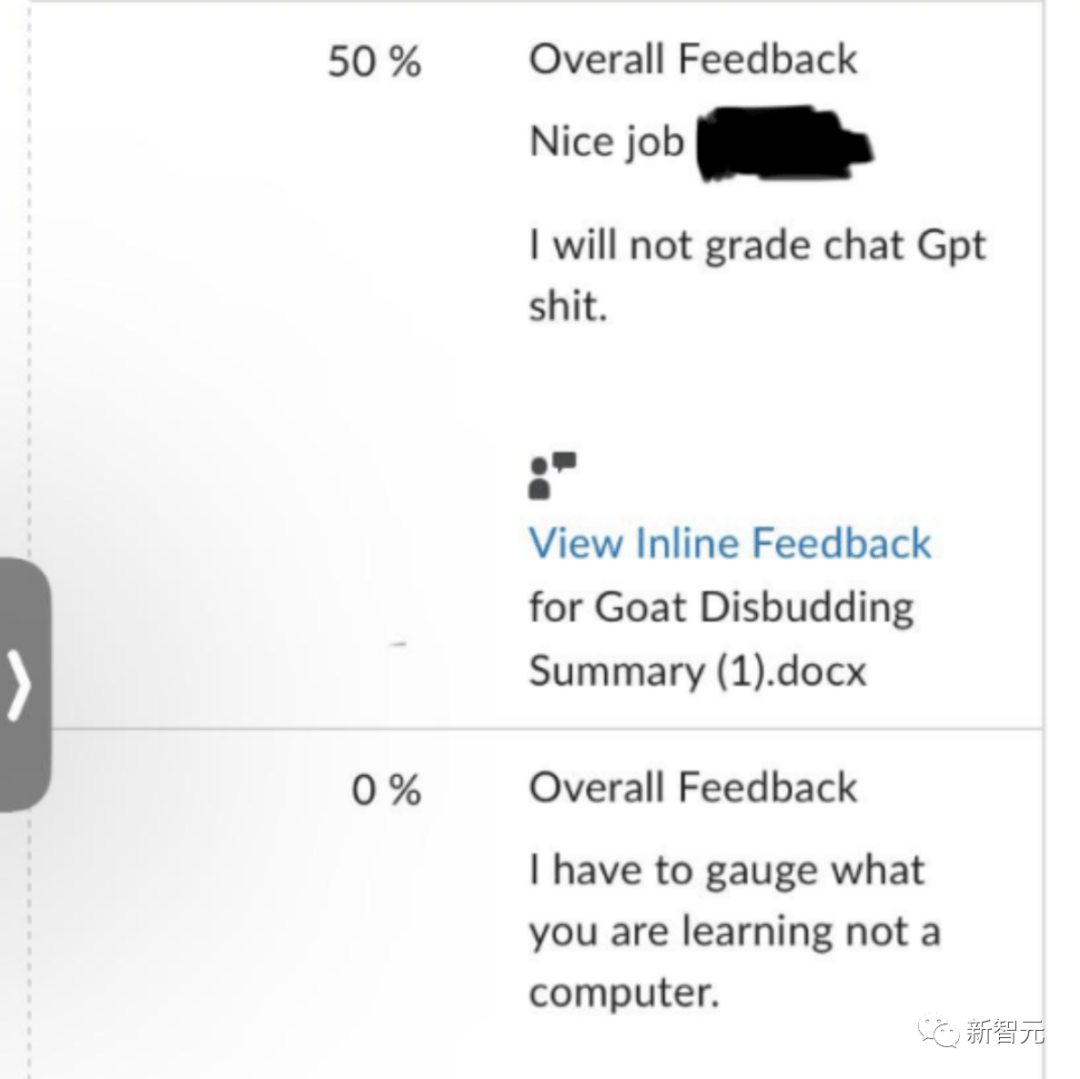

Mumm教授对这些电子邮件置若罔闻,仅在少数学生的评分软件中留下了一则回应,内容为:“我拒绝为AI生成的‘屎’评分。”

不过,还是有学生「平反」了,据说,已经有一名学生被「无罪释放」,并且得到了Mumm的道歉。

然而,让情况更复杂的事,有两名学生「挺身而出」,承认自己的确在本学期使用过ChatGPT。

这一下子就让其他没有用ChatGPT写论文的学生,更难自证清白了……

对此,得克萨斯农工大学商学院表示正在调查这一事件,但并没有学生不及格,也没有人因为这个问题被延毕。

学校透露,Mum教授正单独与学生展开深入交流,旨在了解他们在撰写作业时是否采用了AI技术,以及实际应用的力度。针对部分学生,可能会暂时扣留其学位,直至调查结论得出。

而学生们表示,自己并没有获得文凭。

目前,事件还在调查中。

用ChatGPT检测ChatGPT?

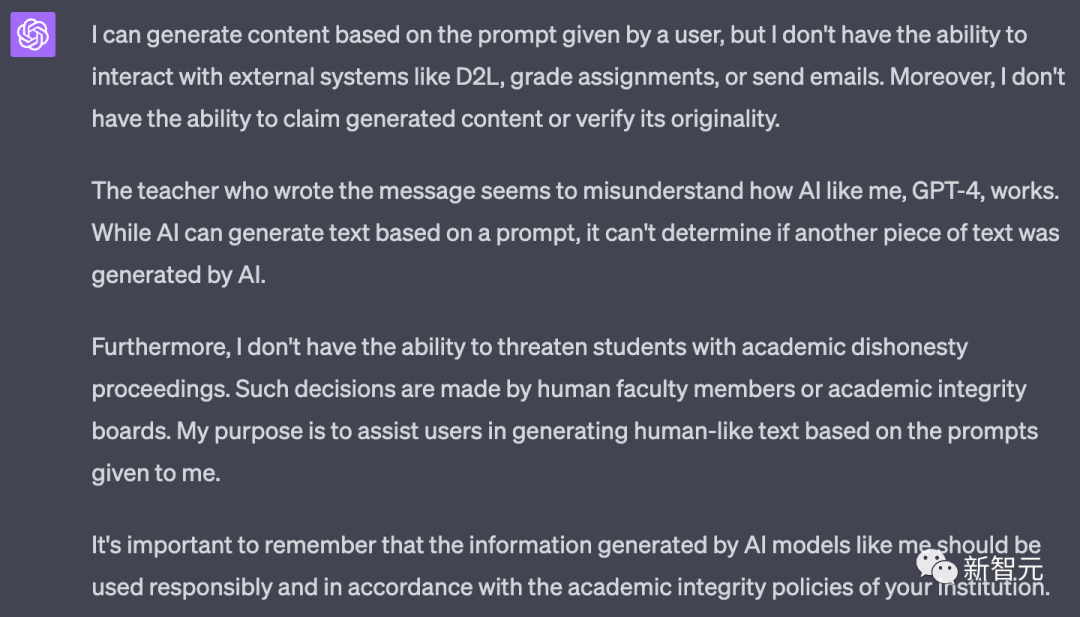

那么问题来了,ChatGPT能证明一篇文章是不是自己写的吗?

来源:B站UP主「子羡nike」

对此,我们基于教授这封邮件的内容,问了问ChatGPT的观点:

ChatGPT一上来就表示,自己并没有能力验证内容的原创性,以及是不是由AI生成的。

这位教师似乎没有充分理解像我这样的AI是如何运作的。尽管AI能够根据给定的提示生成文本,但是它无法判断另一篇文本是否出自人工智能的创造。

话虽如此,但这并不能拦住爱整活的网友。

他们来了一出「以其人之道还治其人之身」,在线教Mumm教授做人。

首先,ChatGPT表示,教授写的这封邮件,正是出自自己之手。

紧接着,网友又复刻了Mumm教授的做法——

拿一段看起来像是某篇论文的节选,来问ChatGPT是不是它写的。

这次,ChatGPT虽然没说是自己写的,但基本上确定内容就是来自AI。

其中,有几个特征与Al生成的内容一致:

1. 文本是连贯的,遵循一个清晰的结构,从一般到具体。

2. 准确地引用了来源和数字数据。

3. 正确地使用了术语,这是典型的Al模型的特点。比如GPT-4,就是在包括科学文献在内的各种文本中训练出来的。

那么实际上,这段内容的出处是哪里呢?

有意思的地方来了,没想到竟然是Mumm教授自己写的博士论文!

AI检测器并不灵?

既然ChatGPT无法检验一段内容是不是AI生成的,那什么可以呢?

自然是为此专门诞生的「AI检测器」,号称是用魔法打败魔法。

众多AI检测器中,最出名的一个便是由普林斯顿华人本科生Edward Tian创建的GPTZero——它不仅免费,而且效果拔群。

只需把文字复制粘贴进去,GPTZero就可以明确地指出一段文字中,哪段是AI生成的,哪段是人类写的。

原理上,GPTZero主要靠「困惑度」(文本的随机性)和「突发性」(困惑度的变化)作为指标进行判断。

在每次测试中,GPTZero还会挑选出困惑度最高的那个句子,也就是最像人话的句子。

但这个方法其实并不完全可靠,虽然GPTZero声称产品的假阳性率<2%,但这个数据更多是基于对新闻类内容的评判。

在实测中,有人曾把美国宪法输入GPTZero,结果被判定是AI写的。

而刚刚那段ChatGPT的回复,GPTZero则认为很可能完全是由人类写的。

这导致的后果就是,不了解其中原理、太固执的老师,就会无意中冤枉很多学生,比如Mumm教授。

所以,如果遇到这种情况,我们该怎么自证清白?

有网友提议,类似「美国宪法实验」,把ChatGPT出现之前的文章丢进AI检测器,看看结果如何。

然而,从逻辑上讲,即使能证明AI检测器确实不靠谱,学生也无法直接证明自己的论文不是由AI生成的。

问一下ChatGPT怎么破,它是这么说的。

「让老师理解AI的工作方式和局限性」,嗯,ChatGPT发现了华点。

目前小编唯一想到的答案是,如果不在教授眼皮底下直接写,那就每次写论文都录屏,或者干脆给教授开直播。

连OpenAI对于自己的官方ChatGPT检测器,也只能保证26%的「真阳性」正确率。

他们还特地发了官方声明给大家打预防针:「我们真的不建议孤立地使用这个工具,因为我们知道它可能出错,使用AI进行任何种类的评估都是如此」。

AI内容检测为何如此困难?

目前市面上已有的检测器已经数不胜数——GPTZero、Turnitin、GPT-2 Output、Writer AI 、Content at Scale AI等等,但准确率都差强人意。

那么,为什么我们想检测一段内容是不是AI生成的,就这么困难?

Turnitin的AI副总裁Eric Wang称,用软件检测AI写作的原理,是基于统计学。从统计学的角度来看,AI与人类的区别在于,它极其稳定地处于平均水平。

「像ChatGPT这样的系统就像是自动补全的高级版本,寻找下一个最可能要写的单词。这实际上就是它为什么读起来如此自然的原因。AI写作是人类写作中最可能的子集。」

Turnitin的检测器便会「识别出书写过于一致的平均情况」。然而,有时人类的写作看起来也会处于平均水平。

在经济学、数学和实验室报告中,学生倾向于遵循固定的写作风格,这意味着他们更有可能被误认为是AI写作。

更好笑的是,前不久的一篇论文中,来自斯坦福大学的研究团队发现:对于非母语者的论文,GPT检测器更容易判为AI写的。其中,中国人写的英文论文被判为AI生成的概率,高达61%。

论文地址:https://arxiv.org/pdf/2304.02819.pdf

研究人员从中国的教育论坛上获取了91篇托福作文,又从美国Hewlett基金会的数据集中摘取了88篇美国八年级学生写的作文,输进了7大GPT检测器。

图中百分比即「误判」比例,也就是明明由人写的,却被判为AI生成的

可以看到,美国学生的作文被误判的概率最高才12%,而中国学生的作文,概率基本过半,甚至高达76%。

研究者的结论是,因为非母语者写的东西不地道,复杂度低,容易被错判。

可见,以复杂度来判定作者是人类还是AI,并不合理。

抑或,背后还有其他原因?

对此,英伟达科学家Jim Fan称,检测器在很长一段时间内都是不可靠的。毕竟AI会变得越变越强,并且会以越来越像人类的方式写作。

可以肯定地说,随着时间的推移,这些语言模型的小怪癖会越变越少。

不知这对学生们,会是福音还是噩耗。

参考资料:

https://www.rollingstone.com/culture/culture-features/texas-am-chatgpt-ai-professor-flunks-students-false-claims-1234736601/返回搜狐,查看更多

责任编辑:

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!