ChatGPT:人工智能的自动编码器与未来指南

文章主题:ChatGPT, 人工智能, 语言模型, 自然语言处理

近期,ChatGPT的热度可见一斑,作为一名在生物医学与计算机科学领域之间游走边缘的人,我也忍不住想要借此机会蹭一下热度。

ChatGPT是一种由OpenAI训练的预训练语言模型,其基础架构为Transformer。此模型的独特之处在于能够生成自然语言文本并展开对话,同时具备捕捉语言之间复杂关系的能力。广泛应用于开发各类聊天机器人、语音助手以及评论生成系统等。

下面我就从我比较擅长的组学生信、数据可视化以及机器学习三个方面测试一下。

生信分析

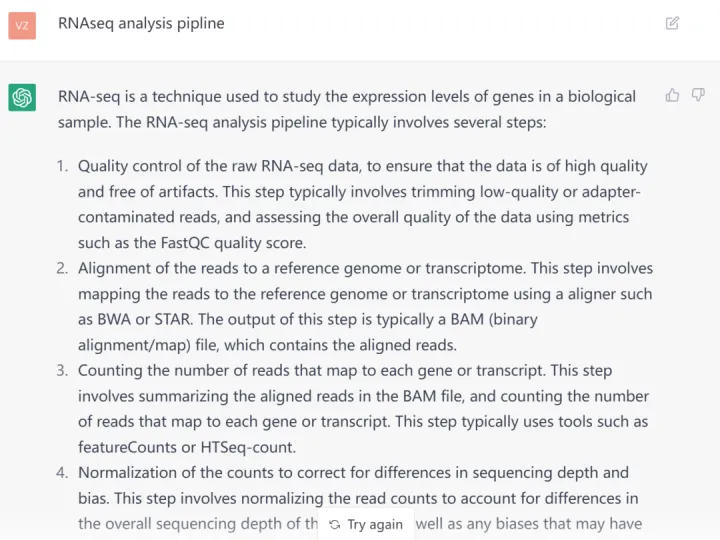

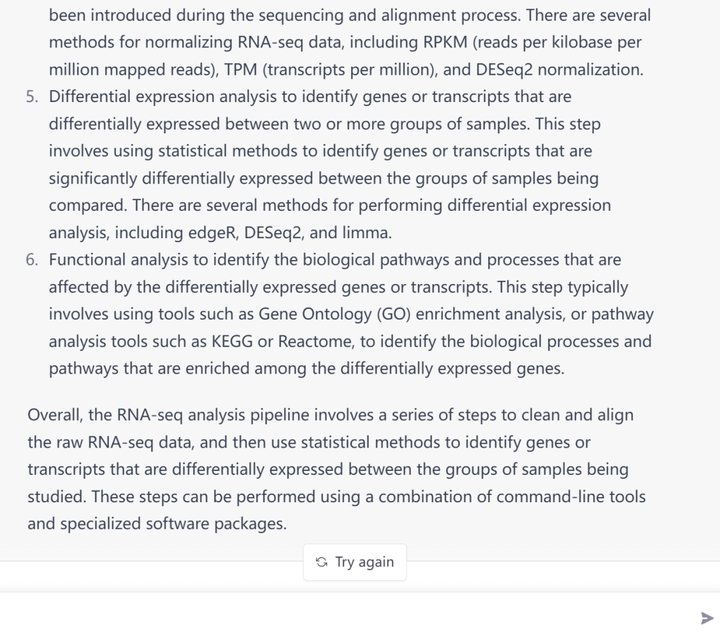

问一下RNAseq分析流程

流程很对就是没有代码,看看能不能给我们写个代码~

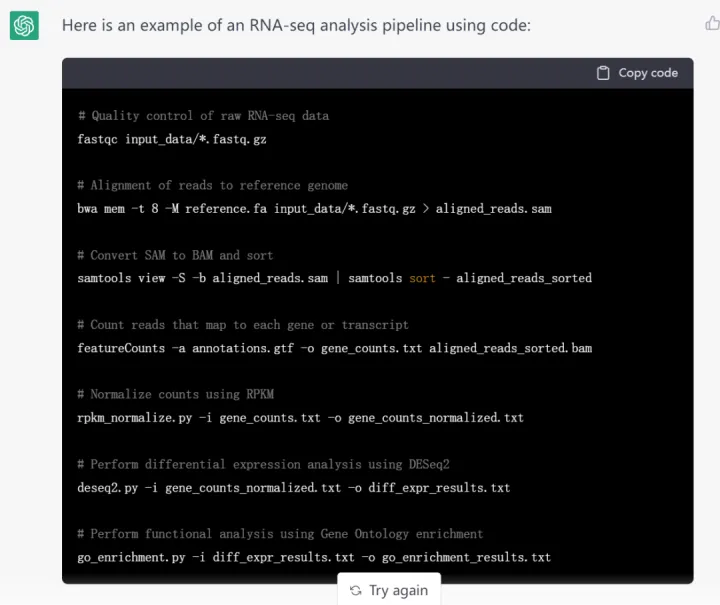

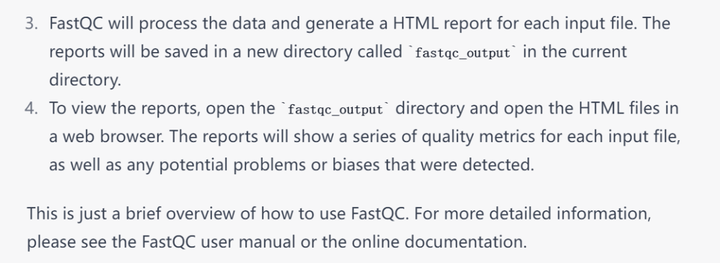

完了,感觉要失业了。用了好多python脚本,看一下有没有代码。

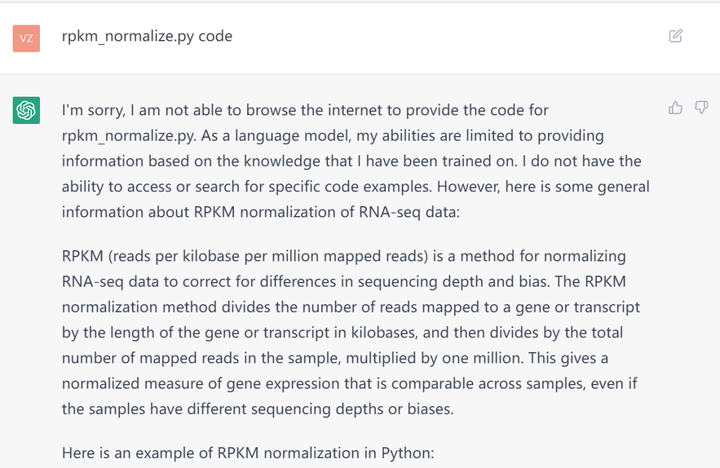

虽然没有代码,但是他给出了一个python进行RPKM 标准化的例子。好牛~

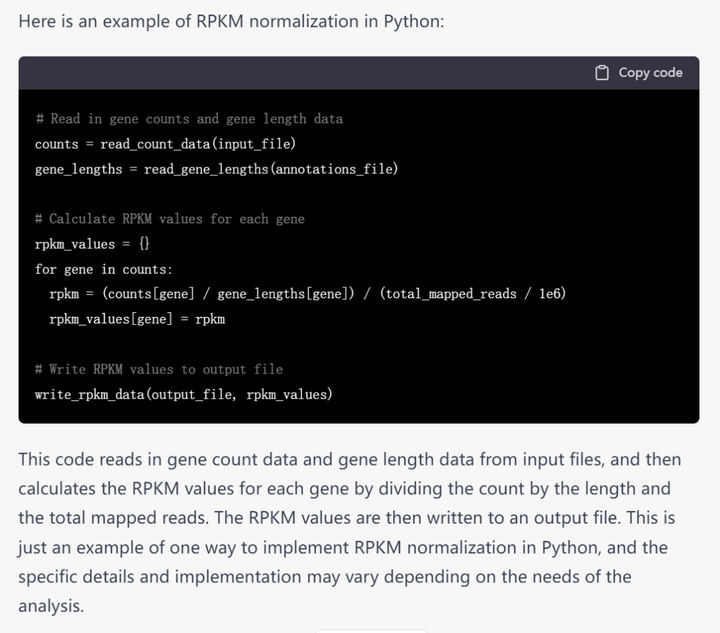

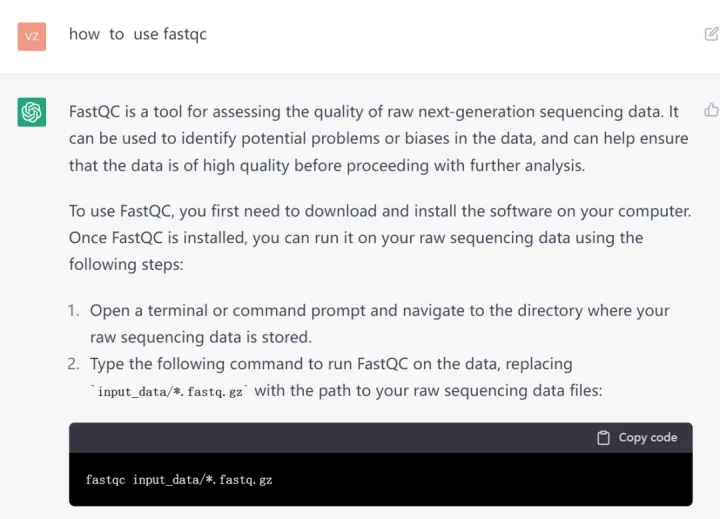

再问一下每个软件怎么用?

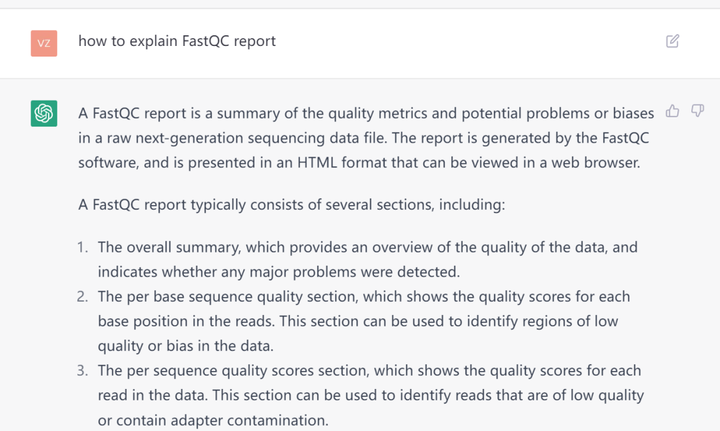

好详细,问一下质控报告怎么解读?

在分析自动化领域的代码生成方面,ChatGPT 的表现可圈可点,但仍有提升空间。尽管这些代码 snippets 可以通过谷歌等搜索引擎轻松找到,但它仍需加强在这方面的能力。然而,只要 complement 以大纲修补补足,ChatGPT 仍然具备一定的实用价值。

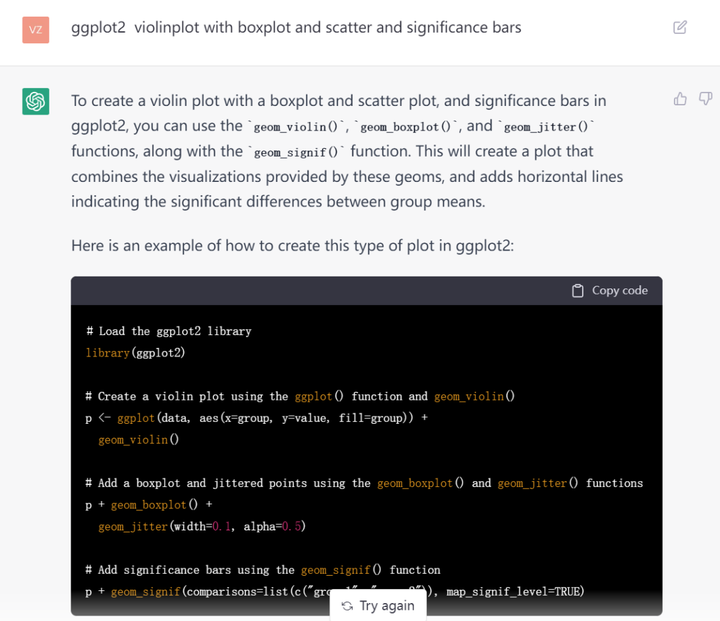

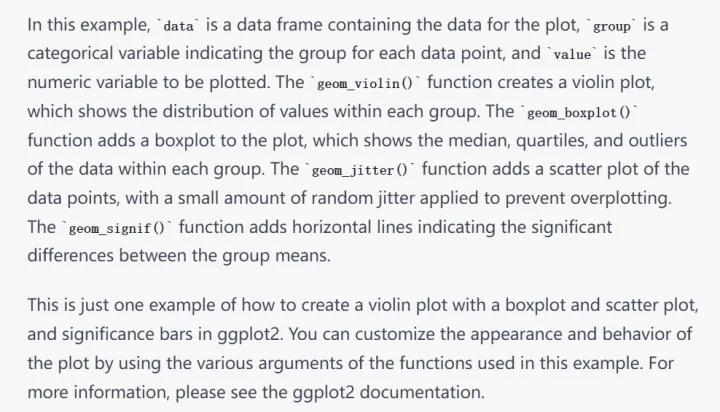

数据可视化

来画个图吧!

把要求写细一点。

可以看到,除了有代码还有每个参数的用法。

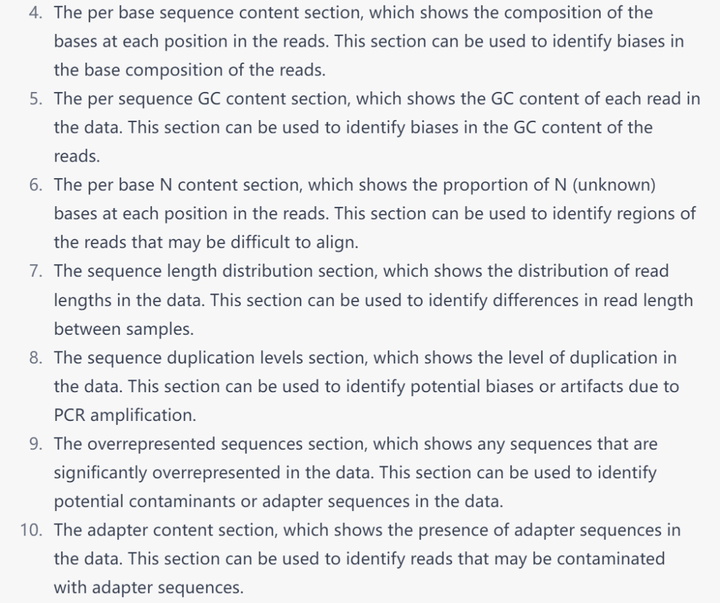

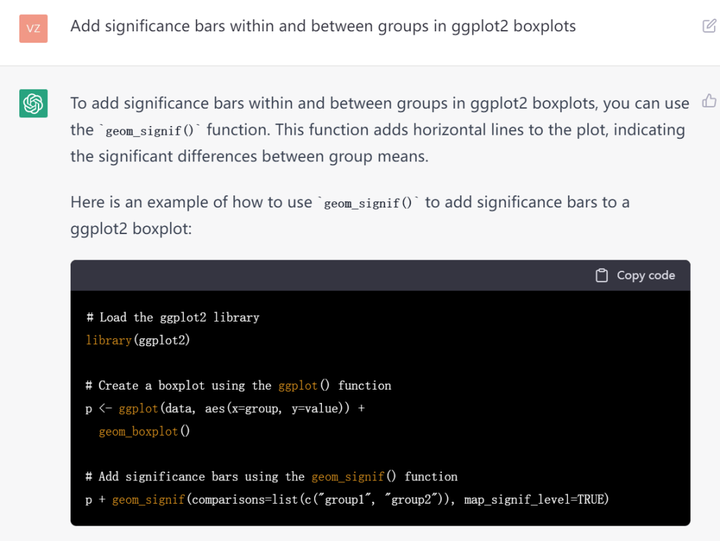

问一下上一篇推文的图怎么画?

用到的函数都给到了~实在是很厉害。

看来,看到不会画的图先问问ChatGPT说不定就有思路了。

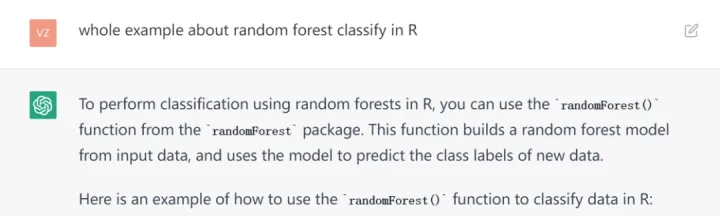

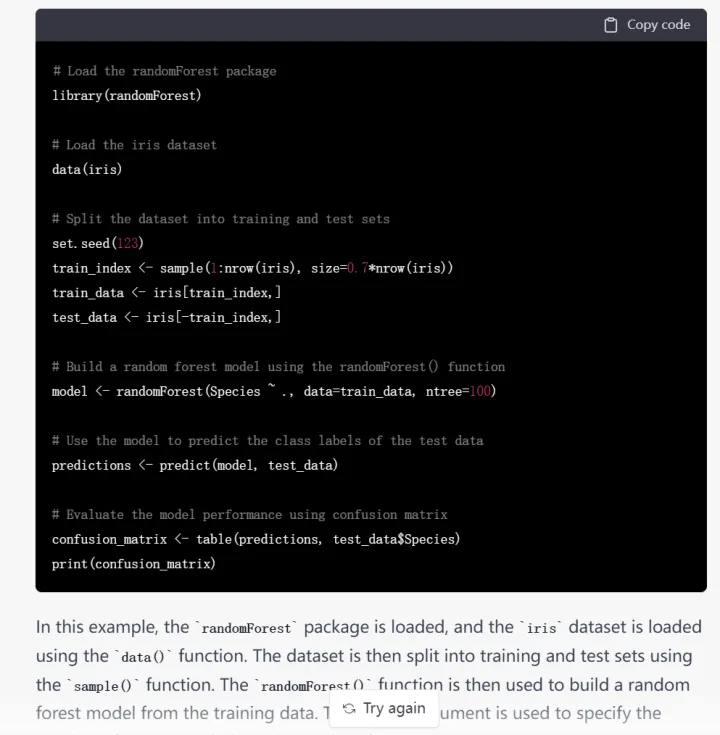

机器学习

机器学习应该是ChatGPT的主场了。

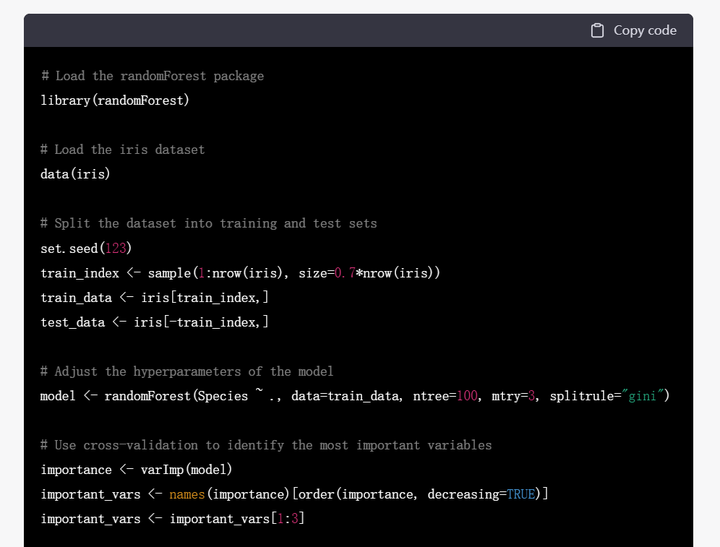

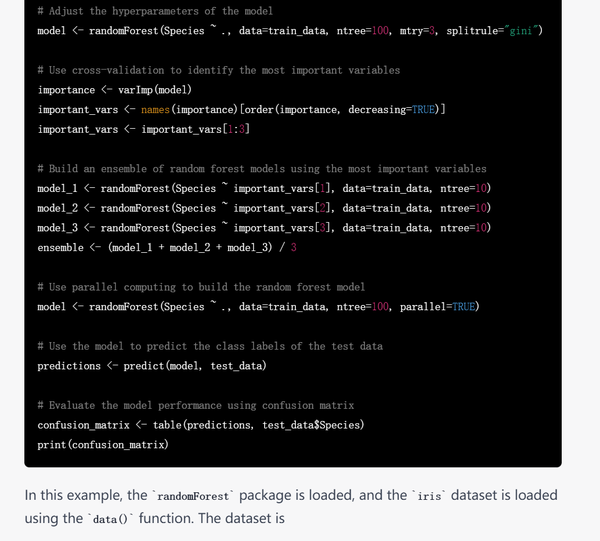

问一下用R语言进行随机森林分类的代码。

怎么调参呢?

总结

在经过一系列测试之后,我想说的是:ChatGPT,你能掌握的技能真是令人惊叹!总体而言,ChatGPT可以在问题解决过程中发挥出AI助手的优势。然而,作为一种新型的技术模型,ChatGPT无疑还有很多需要改进和完善的地方。OpenAI官方网站上已经列举了一些当前存在的限制与缺陷。

ChatGPT偶尔会提供看似有理有据,但实际上错误的答案,这是一个棘手的问题,原因有三:首先,在训练过程中,缺乏现实世界的数据来加强学习;过于注重模型的准确性可能会导致其变得过于谨慎,甚至可能无法回答一些本可以正确解答的问题;其次,由于受到监督训练的影响,模型可能会被误导,误认为理想的答案是基于模型所掌握的信息,而非人类演示者所知道的信息;最后,ChatGPT对于调整输入表述或重复尝试同一提示非常敏感。比如,当给定一个问题表述时,模型可能会宣称自己无法回答,但只要稍作改动,就能准确无误地回答。此外,该模型往往过于冗长,且过度使用一些词汇和短语,如“重申,该模型是由OpenAI训练的语言模型”。在理想的情况下,如果用户的问题不够清晰,模型会提示用户进行进一步的解释。但是,当前的模型往往会猜测用户的意图。

往期内容

CNS图表复现|生信分析|R绘图 资源分享&讨论群!这图怎么画| 有点复杂的散点图这图怎么画 | 相关分析棒棒糖图组学生信| Front Immunol |基于血清蛋白质组早期诊断标志筛选的简单套路(免费教程+代码领取)|跟着Cell学作图系列合集Q&A | 如何在论文中画出漂亮的插图?跟着 Cell 学作图 | 桑葚图(ggalluvial)R实战 | Lasso回归模型建立及变量筛选跟着 NC 学作图 | 互作网络图进阶(蛋白+富集通路)(Cytoscape)R实战 | 给聚类加个圈圈(ggunchull)R实战 | NGS数据时间序列分析(maSigPro)跟着 Cell 学作图 | 韦恩图(ggVennDiagram)

木舟笔记矩阵

本文使用 文章同步助手 同步

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!