独家!利用ChatGPT写财经专栏

ChatGPT继续火遍全球,很多人都说ChatGPT会让包括财经专栏作者在内的工种彻底“自动化”,这部分人的职位可能会不保。

今天,隔壁老邢就来做一个小实验,目标就是要利用ChatGPT来完成一次财经内容的创作,以证明这项新工具不但不会让我们这类作者失业,而且还能成为我们发挥更大能量的有力工具。

首先我写了一篇关于ChatGPT的专栏文,请各位先阅读。

OpenAI的ChatGPT从去年底被推出以来,已经在全球范围内引发了人工智能大讨论和大竞赛。ChatGPT所代表的生成性人工智能新浪潮是一个从文本到图像内容生成的复杂系统。

外媒普遍认为,其将成为未来数年科技发展、工业生产和求职就业最具颠覆性的力量之一。

最近微软内置类似ChatGPT AI技术的新版搜索引擎必应(Bing)正在火热测试中,虽然测试中出现了很多问题(包括错误信息、侵犯知识产权),但依然引得谷歌、百度等其他市场巨头全力扎堆到生成性人工智能的竞技舞台中去。

ChatGPT是由位于旧金山的人工智能研究公司OpenAI开发的人工智能聊天机器人,微软在2019年向这家人工智能初创公司投资了10亿美元,2021年又投资了一笔未披露的金额。看到这项技术如此的受欢迎,今年1月份微软再次投资约100亿美元。

几乎刚发布后,人们就发现这种新聊天机器可以和人自动自发地聊天,从历史到哲学的话题到生成类似泰勒·斯威夫特风格的歌词,再到帮助人们写编程代码,几乎无所不能。

一位外国投资公司的高管最近在其社交平台上举了应用ChatGPT进行股票分析的例子。它能在几秒钟内阅读分析完5000份资产负债表,能够提取出所有需要的财务信息,并计算出风险分数,这完全能够帮助分析师对投资组合的风险做出决定。

体验了其高效完成这以往需要很多人花很多时间才能完成的工作后,这位投资界高管认为,传统的人工智能只解决了“深度分析空间”的问题,而ChatGPT这种新的人工智能技术将这些能力带入了创意中去——每个人的都可以创造性地去决定如何使用它。

从技术上讲,ChatGPT是根据从互联网上搜罗的大量文章、网站和社交媒体帖子以及与OpenAI雇用的真人的实时对话(主要是英语)来被训练的。由此它学会了模仿写作的语法和结构,并能轻松说出经常使用的短语。

支撑ChatGPT的主要技术就是GPT,其代表一种生成预训练的变形器(Transformer)。变形器是一种在数据序列中寻找长程模式的专门算法,其不仅能学会预测一个句子中的下一个词,而且还能学会预测一个段落中的下一个句子和一篇文章中的下一个段落。这是它能够在长时间的文本中保持主题的原因。

因为训练变形器需要大量的数据,所以它的训练分为两个阶段:首先,它在通用数据上进行预训练,这些通用数据更容易被大量找到;然后它在对话等特定任务中进行微调,以学习对话的特点。

从这一点上,我们可以轻易看出一个问题:ChatGPT的信息来源没有经过事实性的核查;而且它依靠人类的反馈来提高其准确性,这种反馈可能包含不准确的信息。

微软是OpenAI的最大投资者,根据协议,微软可以使用OpenAI的研究进展,包括GPT-3和ChatGPT,来创造新产品或增强现有产品。微软也是OpenAI之外唯一可以为这些技术提供API的公司。

相对于微软的春风得意,另一个科技巨头谷歌就很难受了。因为正是谷歌的研究人员在2017年发明了变形器,但今天谷歌基于变形器的聊天机器人谷Bard似乎性能远落后于ChatGPT。我国科技巨头百度也正在使用类似的变形器来发展自己的ChatGPT,其计划在3月前将这个新机器人整合到搜索引擎中。

这些自动模型技术事实上还是不能少了人类的参与。华东师大软件工程学院党委副书记曹桂涛教授最近表示,ChatGPT在训练过程中高薪聘请了大量的“提示工程师”,通过“标注”、巨量的语料来拟合真实世界;ChatGPT可能会出现创造不存在的知识,或者主观猜测提问者的意图等问题,因而模型的优化将是一个持续的过程,这也需要人的智能和软件工程师的长期努力。

从人伦道德上讲,如果用于训练的数据本身出现大量的错误和低劣道德内容,则理论上ChatGPT将会成为一个“坏人”,其所产生的内容将非常具有伤害性。

一些国外艺术家已经表示,基于GPT的人工智能图像生成器剽窃了他们的艺术作品,这威胁到他们的生计,而部分软件工程师则表示,基于AI的小段代码生成器有可能会损害他们的大块代码。

国外社交平台上也经常有人爆料,ChatGPT和其他AI文本生成器可能会吐出种族主义和性别歧视的内容。另外,它也常常在事实表述、常识相关的理解、复杂逻辑推理、幽默等情感理解、会话的逻辑一致性方面出现明显的问题或差错。当这些问题和它流畅的自然语言表达结合在一起,就呈现出“一本正经的胡说八道”的即视感。

对此OpenAI表示,它将聘用真人标签工程师来不断完善聊天机器人的内容输出,以限制上述这些错误的发生。它还使用内容管理过滤器来限制ChatGPT的反应,避免政治上有争议或能使人产生不愉快的话题输出。

但一些外媒又开始担心起这些“人为操控因素”到底会在多大程度上控制ChatGPT的内容,从而会影响到人们正常获得信息的权利。

除此之外,人们还普遍担心ChatGPT会“抢夺”自己的工作饭碗。

与每一波自动化技术一样,最新的技术可能会对工作产生重大影响。在早期机器自动化的浪潮中,蓝领工人首当其冲。如今,生成性人工智能将可能对白领职业产生更大的影响。据布鲁金斯学会几年前的一项研究,人工智能对营销人员、财务顾问和计算机程序员等工作的影响最大。

总结全文,人们普遍把生成性人工智能比作类似云计算或移动互联网一样的产业界革命,但事实上,生成性人工智能的意义可能已经远远超过互联网搜索等“老时代”,将会是一场重大的社会变革。

相对于其他已有的人工智能算法,ChatGPT在一个关键方面是不同的,它重新定义了机器可以学习的限制,要说重要性的话,可能用人类历史上的工业革命来对比才更加符合。与工业革命时候类似,那些不立即拥抱这项新技术的公司或者团体可能会被加速淘汰。

各位读完这篇文章后,是否觉得意犹未尽呢?

基于这篇原创稿子,我用ChatGPT继续来“做文章”,请国外一位朋友帮我完成。

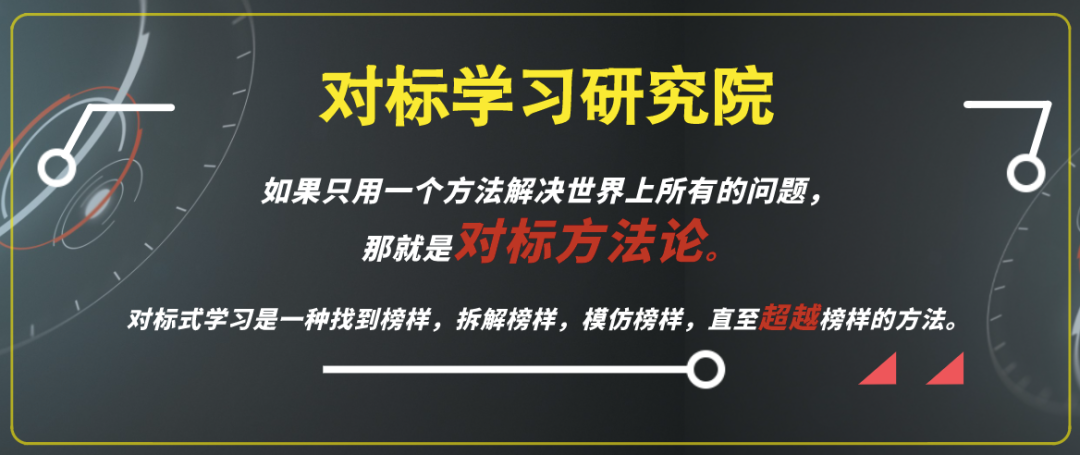

首先,我让ChatGPT总结我上面这篇文章,得到了一组结果,如下图所示:

其次,我让ChatGPT精炼出我上面这篇文章的核心内容,得到了一组结果,如下图所示:

可以发现,ChatGPT确实可以帮助我们精简文章的内容,以达到一种言简意赅新闻稿的水平,产出那种类似“电报”的文体。

但从内容的趣味性和作者所要表达的深度上来看,其精炼或者总结的结果输出似乎还达不到真人的水平,内容非常平直。

综合来看,那些真正有写作能力,能写出高度逻辑性和趣味性文字的财经作者依然短期内不会被ChatGPT所取代;而那些机械性的“平直”文字内容输出者,诸如某某财经电报、财经快讯等文体的内容有更大概率由人工智能所完成。