AI时代:从语言革命到生成式创新

文章主题:人工智能, 大语言模型, 聊天机器人, 生成式内容

5月25日,2023届小蛮腰科技大会以及AIGC人工智能峰会于广州盛大启幕。在此次会议上,享有“人工智能女王”之称的卡耐基梅隆大学计算机学院講席教授兼前副院长贾斯汀·卡塞尔(Justine Cassell),法国国家信息与自动化研究所(Inria)研究主任,为我们带来了题为《从大语言模型到ChatGPT:AI时代的语言革命》的精彩演讲。她坚信,我们即将迎来许多前所未有的发展机遇。

小蛮腰科技大会上,贾斯汀 · 卡塞尔带来主题演讲。

在探讨人工智能(AI)这一议题时,贾斯汀·卡塞尔指出,AI并非仅仅是一项技术,它实际上是一种模型、一种状态和一种模式。目前,我们不仅能够使机器学习如何执行任务,而且还能够让机器在学习过程中超越人类。这标志着AI技术的巨大进步,进一步推动了人类社会的变革与发展。

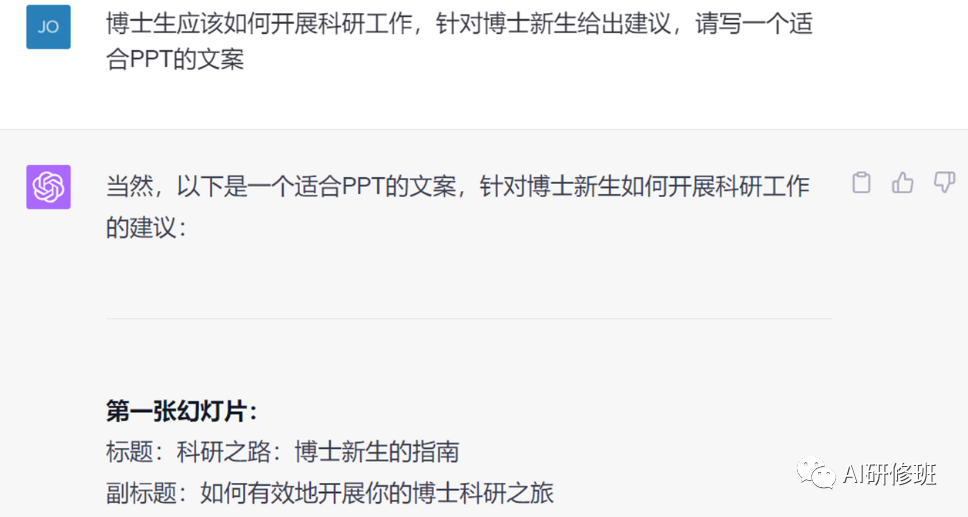

她探讨了人工智能领域的一种核心技术——大型语言模型(LLM)。作为一款AI系统,其运行需要海量的数据 input、先进的模型设计以及算法的支持。这使得我们能够洞悉话语中的下一单词、预测句子结构的走势,以及在对话中预期下一步的发展方向。因此,当她在撰写邮件时,键入“how”这个词汇,算法立刻能回应“How are you(你好吗)?”等问题,这正是大型语言模型的强大功能所在。

她所提到的“生成式”是AI的另一个重要特性。她解释道,生成式的AI代表了全新的系统概念,这是我们首次能够创建具有独特性和原创性的文本、图像或音频内容。这种创新性的人工智能技术能够为我们带来前所未有的可能性,开拓全新的创作领域。

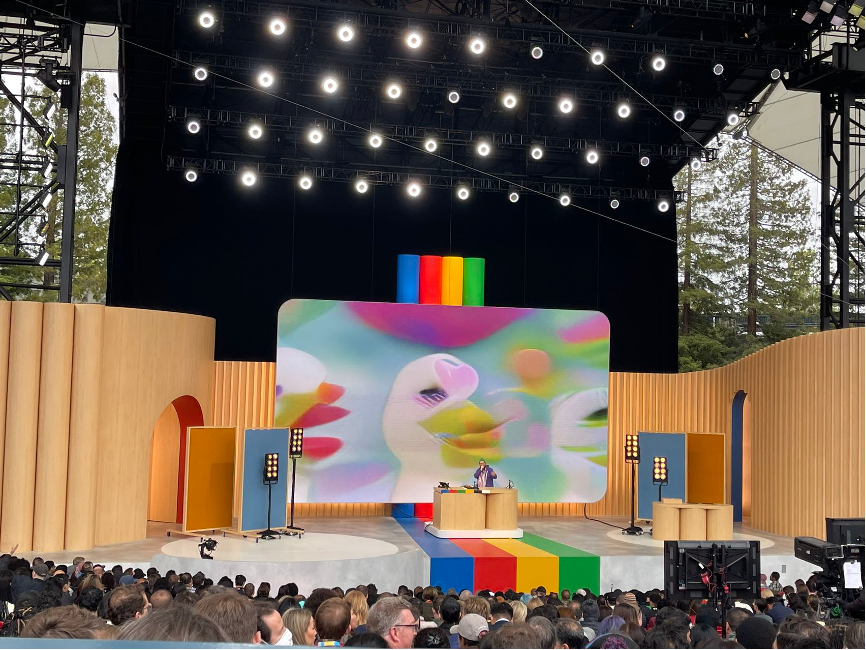

以AI系统为例,尤其是目前备受瞩目的ChatGPT,贾斯汀·卡塞尔指出,它在各种场合中被广泛提及,其功能在于进行自然对话,这与我们过去所熟知的对话并无二致。然而,不同的是,ChatGPT生成的对话是原创的,它可以创作图像、艺术作品等前所未有的内容,为艺术家们打开了一片全新的领域。

我们必须明确一点,ChatGPT并不具备自主行动的能力。尽管它是一种LLM(语言模型),能够将正确的措辞和推理过程作为模块集成到其计算中,但它并未获得自主进行逻辑推理的能力。因此,ChatGPT所提供的答案有可能出现错误。它本质上只是一個对话框,儘管它具有很高的科技感,但其功能仍然局限于提供信息。当前,ChatGPT尚未具备自主思考的能力。

” 除了没有推理能力,ChatGPT 也没有记忆能力。”” 我也非常自豪,同时我们也看到这些年轻计算机科学家,他们现在正在研究关于推理和记忆方面的老论文,来看看有没有一些传统的方式,比如说这些标志性的 AI 以及和大语言模型结合起来,看一看到底什么是重要的,下一句话应该说什么,以及使得新的 ChatGPT 可以记住他们所说的话。”

她谈道,增加透明度也是非常重要的趋势。微软介绍了 ” 必应 “,把必应和 ChatGPT-5 结合在一起,为什么他们要这么做?” 因为他们希望信息是准确的,所以我们不仅仅只是需要准确的信息,同时如果我们希望从大语言模型获得信息,我们想知道这些信息的来源是哪里,来源必须要透明。”

据她分享,还有一个技术叫微调,它可以让我们添加自己的数据,在大语言模型被输入之后可以继续添加数据,这叫作微调。贾斯汀 · 卡塞尔说,她的学生正在研究这方面的工作,或者重新排序,可以确保专门的术语、专门的行业和专门的数据库能够应用起来,让这些大语言数据变得更加有用。

采写:新快报记者陈慕媛

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!