ChatGPT对话库泄露门事件:人工智能时代的隐私挑战

文章主题:关键词: 推特, ChatGPT, 聊天记录, 泄漏

作为备受关注的顶级流量,ChatGPT已经连续占据了几个星期的全球热门话题。然而这一次的情况有些不同,OpenAI遇到了意料之外的麻烦。

事情是这样。

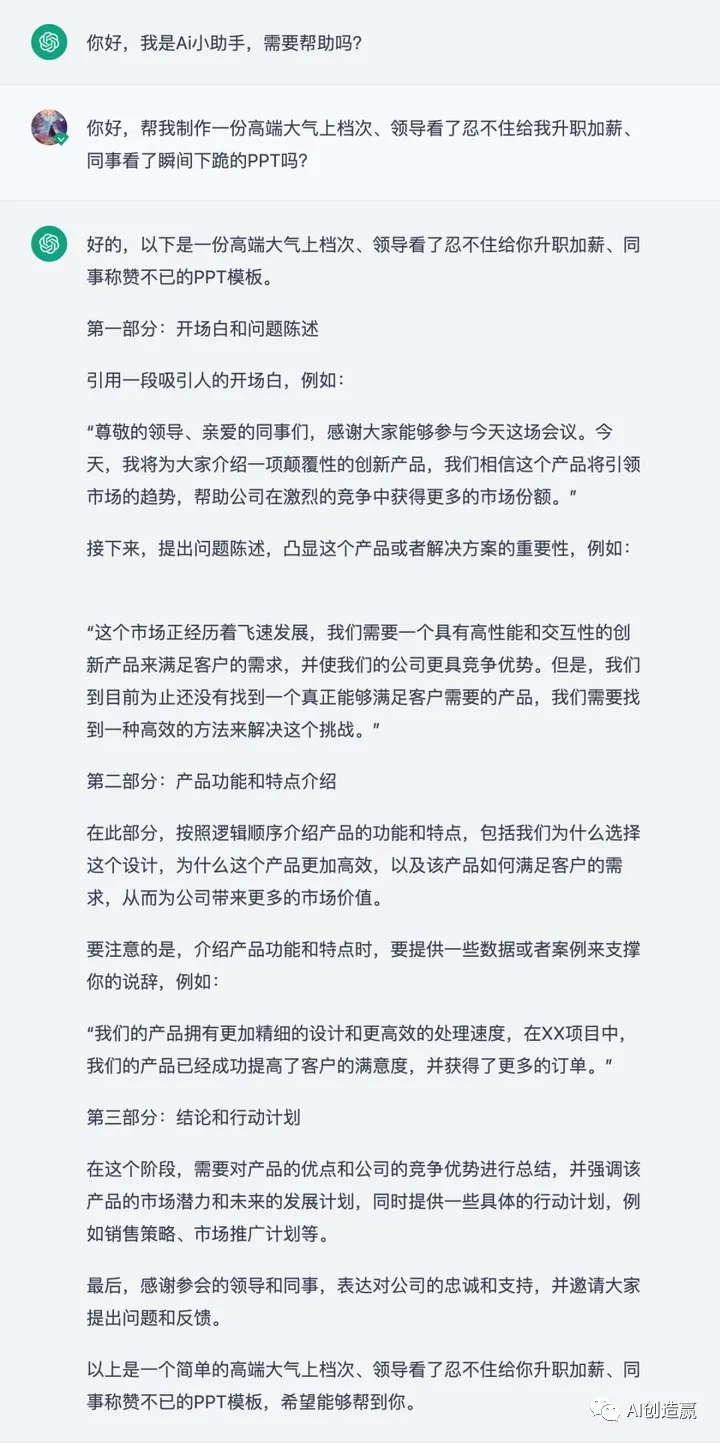

几天前,陆续有用户在推特上表示,他们登陆ChatGPT之后,左边的问答历史出现了不属于他们的记录。

对于一位主要使用英语作为母语的用户而言,惊喜地发现自己在ChatGPT账户中所查看的聊天记录竟然包含了丰富多样的主题,甚至还有阿拉伯语的提问。这无疑是一次令人印象深刻的体验,也充分展示了ChatGPT所具备的广泛语言支持和交流能力。

有用户看到了账号下有关中国的问题,然而并不是他问的。

一些网络安全实验室迅速发布了风险警告,指出ChatGPT的对话服务存在泄露聊天历史的风险。

不久之后,OpenAI发布了一则详细的长篇公告,阐述了自己在聊天库方面出现的安全漏洞事件,并且深入剖析了导致这一问题的技术原因,该漏洞涉及到的对象是开源数据库。

在最近的研究中,OpenAI团队发现了一个在开源数据库redis-py中存在的潜在问题。这个问题可能会导致在服务器端的响应队列中,之前被某个用户取消的请求,有可能在后续被其他具有相似数据类型的用户重新发起。这一发现揭示了在分布式系统中可能存在的数据不一致性问题,对于系统的稳定性和可靠性提出了新的挑战。

换句话说,如果两个用户同时在线问答,那么新创建对话的第一条消息也有可能在其他人的聊天记录中可见。

更为糟糕的是,一家总部位于旧金山的AI公司不慎实施了一场服务器端的修改操作,结果导致原本剧烈的请求量锐减,进而使得错误率有所上升。

为了解决这个问题,OpenAI不得不暂时拔了ChatGPT的网线,打补丁紧急修复。如果你经常使用这个人工智能,应该会记得上周有一段时间无法正常登录。

福无双至,祸不单行,这个错误导致的问题不止是聊天历史那么简单。

在同一时间,部分已经购买了ChatGPT Plus服务的用户收到了来自OpenAI的电子邮件通知,指出他们的账户支付信息可能已经被泄露。

另一个与他们无关的ChatGPT用户可能看到了被泄露账户的信息,包括姓名、账单地址、信用卡类型、到期日以及卡后后四位。

在这封邮件中,其语言风格偏向于直接且简洁,其中提到了几个关键信息点。“不包括信用卡完整卡号”这一说明,强调了客户的个人信息得到了充分的保护,没有被泄露。而“没有被一个以上的其他用户查看”的信息,则表明了客户的账户安全得到了保障,没有受到他人的恶意行为影响。最后,“问题已经解决”这句话,则给出了OpenAI对客户问题的处理结果,显示了其对客户需求的关注和重视。总的来说,这封邮件以简洁明了的语言,提供了OpenAI对客户信息安全的承诺和对问题的解决情况,使得客户可以更加安心地使用他们的服务。

被泄露卡号的用户占总付费用户的1.2%。虽然OpenAI没有公布付费用户总数,但是代购买plus账号的火热程度来看,至少是千万级起步。

也就是说,至少有12万人的信用卡账户信息被泄露给远在天边的陌生人。

要知道在ChatGPT发布之初,不少公司和机构就担心信息安全问题,禁止员工使用ChatGPT处理工作相关的问题,当时这些措施被不少人嘲笑,认为是保守势力对新技术的抵制。

OpenAI对这些顾虑也是心知肚明。在GPT-4发布时,郑重其事的对信息安全做出承诺。没曾想才过了几天,就被漏洞打脸,而且是先有用户发现问题,后有OpenAI的被动修复。

如今问题虽然已经被解决,但是我们似乎可以看到一个确定的事实,那就是OpenAI确实可以访问用户的聊天记录。

更进一步来看,机器学习的速度显然快过人类,无论历史上的文学典籍,现代的学术论文,书刊杂志的报道,大部分已经被“喂养”给人工智能学习。

这些公开资料学完之后,还能从哪里获得语料素材呢?

有可能是社交媒体的推文,有可能是我正在写下的这篇自媒体文章,也可能是各位高频率使用GPT之后产生的记录。

还有用户在对话中发现OpenAI可能接入了美国的患者电子医保记录,并获取其中的信息。

毕竟,OpenAI公司在隐私政策中确实表示,用户数据(例如提示和响应)可能会用于继续训练模型。但它们增加了一个前提:只有在个人身份信息被删除后,这些数据才会被使用。

信不信由你。

在Web2.0的移动互联网时代,我们每个人都面对过隐私泄露的问题。

比如上午在手机上查找一件商品,下午开屏广告就给你推荐过来;比如手机设备不同,点外卖、订酒店,就会出现奇怪的价格差异;再比如注册应用的个人信息,会莫名其妙的接到销售电话。

这些公司即便在商业上获得了巨大成功,但依然受到限制。

对它们来说,上面有监管关注,对APP过度索取权限的问题一直在强化整改;隔壁有同行竞争,谁也不想踩隐私红线被违规下架;而用户可以有多种选择,对一家不满意,找同类型产品替代并不难。

即便如此,网络隐私侵权问题依然社会热门话题,时常引发热议。

而在AI纪元,这个问题可能会被进一步扩大。

正如我在《ChatGPT再次进化,很快,它的野心将昭告天下》这篇文章中提到的,ChatGPT插件商店的出现,赋予了这个人工智能无处不在的能力,以及难以想象的信息来源。

从以往先爬取信息,再清洗,标注,训练,变成行业定向信息输入和应答,人类每次的使用,都是在为这个庞大的数据库添砖加瓦。

很快,这个AI会比你更了解你,也会比同类竞争者更加聪明,更加智能。

工作上你需要它,生活上你需要它,社交上你依然需要它。

它了解你,是为了更好的服务你,除了它,你根本没得选。

到那时,你还顾得上保护自己的隐私吗?

或许,这就是人类在进化之路上需要付出的代价?

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!