《人工智能助手在学术论文写作中的风险与挑战》

文章标签:ChatGPT, 论文润色, 人工智能内容生成

原标题:当你想用ChatGPT写作或润色论文时,你必须注意潜在风险

关键词:ChatGPT,论文润色,英语润色,埃米编辑

以下内容首发于微信公众号:【埃米编辑】。关注埃米编辑,写作投稿更容易~如有论文润色需求,可以联系我们哦~

在2023年的9月20日,我国的中国科学技术信息研究所(简称“中信所”),联手Elsevier、Springer Nature以及Wiley这三家全球领先的出版集团,最终完成了一份名为《学术出版中AIGC使用边界指南》的重要报告。这份报告在经过深入研究和讨论后,终于对外正式发布了。

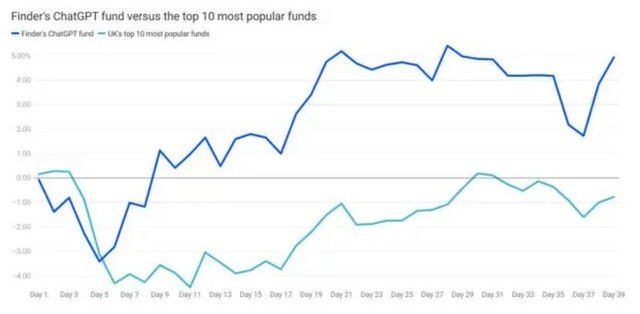

近年来,人工智能技术得到了迅猛的发展,特别是在2022年11月,人工智能聊天机器人ChatGPT的问世,使得人工智能内容生成(Artificial Intelligence Generated Content,简称AIGC)逐渐成为公众关注的焦点。如今,AIGC已经在各个领域被广泛应用,甚至有些科研人员已经开始利用它来撰写论文或进行文本润色。然而,值得注意的是,像ChatGPT这样的人工智能语言模型仍处于开发过程中,因此它们在使用过程中仍存在许多局限性。接下来,让我们一起深入了解这些令人兴奋的技术动态吧!

1 ChatGPT的潜在风险

1) 安全风险

OpenAI虽然已经实施了众多安全措施,但仍然存在因为安全漏洞或错误而引发的数据泄漏风险。 instance,在2023年3月,一度出现了的一个漏洞,使得部分用户可以看到其他用户的聊天标题,同时还能获取到有限的个人信息和账单信息。

对于研究人员而言,在使用ChatGPT进行论文润色时,需特别关注潜在风险。一旦您的论文全部或部分内容被输入ChatGPT,其就可能成为大型语言模型训练的语料库之一。换言之,存在稿件泄露的可能,特别是在同领域另一位学者也使用ChatGPT进行润色的情况下。因此,在利用ChatGPT时,务必谨慎对待,以确保论文安全。

2)不可避免地犯错或不精确的措辞

ChatGPT 是一个持续进化的语言模型,它在发展过程中可能会出现错误。因此,在使用 ChatGPT 时,我们需要谨慎对待,仔细审查其生成的论文,特别是在语法、数学、事实和逻辑方面,以确保其准确性。

更为严重的问题是,聊天机器人在面对一些问题时,往往无法真实地认识到自己的无知,反而會編造一個看似有理有据的答案。它們往往会選擇提供一個看似更加”完善”的答案,卻忽視了事實的真实性。換句話說,這些聊天機器人非常擅長于死循環地胡說八道,當你沒有足夠的信息和判斷力時,很容易便會被其所誤導。

3) 有偏见的答案

ChatGPT 和其他语言模型一样,也面临着固有偏见的风险。人们担忧,广泛应用人工智能工具可能会使文化、种族和性别偏见永久化。这种担忧主要由以下几个原因造成:

◆ 初始训练数据集是如何设计的;

◆ 由谁设计;

◆ 随着时间的推移,模型的 “学习 “效果如何。

在人工智能领域中, chatbots 的设计往往依赖于其内置的知识库,而这个知识库的质量和准确性直接决定了 chatbot 的回答方式和语言表达。然而,由于人类自身的偏见和局限性,这个知识库可能会存在一定的偏差和不准确性。因此,如果 chatbot 仅仅依赖这个知识库来生成回答,那么它的输出结果可能会受到影响,出现偏见和错误。这种现象几乎所有的人工智能工具都面临着,因此在设计和使用 chatbots 时,我们需要特别注意这个问题,并采取相应的措施来减少偏见的影响,保证 chatbot 的回答准确性和公正性。

4) 乏人类洞察力

虽然ChatGPT非常擅长对特定的提示或问题生成连贯的回复,但它终究不是人类。因此,它只能模仿人类的行为。这就产生了各种影响:

1. 并不总能理解一个话题的全部背景,这可能导致无意义或过于直白的回答。

2. 不具备情商,无法识别或回应讽刺、挖苦或幽默等情绪暗示。

3. 并不总能识别成语、地方语言或俚语。相反,它可能会从字面上理解 “raining cats and dogs “这样的短语。

4. 没有实体存在,无法像人类一样看到、听到或与世界互动。这使得它无法根据直接经验来理解世界。

5. 回答问题的方式非常机械,很容易看出是由机器生成的,通常来自模板。使得学术论文缺乏创新性。

6. 只看问题表面,不一定能理解潜台词。虽然偏向中立通常是件好事,但有些问题需要你选择立场。

7. 可以总结和解释一个话题,但无法提出独特的见解。人类需要知识来创造,但生活经验和主观意见对这一过程也至关重要——ChatGPT无法提供这些。

5) 过长或冗长的答案

ChatGPT的训练数据集鼓励它从许多不同的角度来涵盖一个主题,用它能想到的各种方式来回答问题。

虽然这在某些方面是积极的,但在有些话题中,最好的答案肯定是最直接的答案。这种过度解释的倾向会使ChatGPT答案过于正式、冗长。

2 想用ChatGPT,该注意什么

1) 批判性的评估产出内容

仔细检查论文,避免出现语法、逻辑等错误。一定要使用可靠的来源验证信息。

2)遵循所在机构或期刊的要求

咨询所在机构关于使用人工智能写作工具的政策。现在,大多数期刊都需要作者在稿件中披露人工智能辅助技术在写作过程中的使用,具体要求可查看目标期刊的作者指南,例如:

During the preparation of this work the author(s) used [NAME TOOL / SERVICE] in order to [REASON]. After using this tool/service, the author(s) reviewed and edited the content as needed and take(s) full responsibility for the content of the publication.

3) 仅通过OpenAI网站或官方app使用ChatGPT

ChatGPT官方应用目前仅在iOS设备上可用。如果您没有iOS设备,请使用OpenAI官方网站访问该工具。不要冒险下载欺诈或恶意软件。

4) 不要输入敏感信息

ChatGPT 通常会保存用户输入的信息,用于优化未来的模型。因此,避免在该工具中上传敏感信息。

如果担心ChatGPT有安全风险,又想要润色论文,那么可以考虑使用专业的润色机构进行论文润色,埃米编辑是个不错的选择,全部都是美国本土资深编辑润色,不仅可以帮你节省时间和精力,还能提高文章质量,增加接收概率。

责任编辑:

ChatGPT, 论文润色, 人工智能内容生成